Il ne s’agit pas d’une tendance des dernières décennies, mais de siècles passés, qui conduit progressivement l’humanité à vivre dans un monde d’information. Avec l’écriture, est apparue une technique culturelle permettant à l’être humain de créer un monde, le « corpus de connaissances ». Depuis longtemps, ce corpus est si vaste qu’il est impossible, en une vie humaine, de prendre connaissance de plus qu’une fraction infinitésimale de ce gigantesque univers de savoir et d’information. Dans ce contexte, se pose la question : sur quelle base pouvons-nous nous considérer capables de juger ? Mais supposons que nous puissions, par exemple, lire tous les textes jamais écrits sur la question de la chute d’une pierre : les textes d’Aristote, les traités des scolastiques, les auteurs de la philosophie mécanique moderne jusqu’à Galilée, les traités de Newton, les théories quantiques des multivers et enfin les théoriciens des cordes. Cela nous rendrait-il capables de juger ? Je ne le crois pas. En fin de compte, c’est notre corporéité – et la possibilité qu’elle offre de nous confronter à la réalité, ici sous forme d’expérience – qui nous permet véritablement de saisir la cohérence et le sens de l’ensemble de ces analyses. Des êtres désincarnés ne peuvent, quelle que soit leur intelligence, appréhender la question. Chaque fois qu’une question touche notre monde, qu’elle soit scientifique, culturelle ou politique, elle ne peut être résolue dans l’espace purement logique, mais seulement par une confrontation au réel. C’est pourquoi les sciences naturelles ne reposent pas sur le savoir, mais sur l’expérience, celle-là même qui nous rend capables de juger.

Phénomènes d’émancipation de l’information

Cependant, il devient de plus en plus ardu de confronter le réel dans la masse d’informations actuelle. La mondialisation des médias, en particulier numériques, amène de plus en plus les lecteurs à admettre leur incapacité à porter un jugement, puisqu’une confrontation avec la réalité est devenue impossible, tant sur le plan spatial que temporel. Il est souvent difficile aujourd’hui de vérifier l’information : elle se « détache » des contextes de vie personnels. En tant que physicien, je connais bien ce phénomène : dans d’immenses ensembles de données, il est possible de dénicher presque n’importe quelle affirmation et de l’étayer logiquement par divers contextes, sans pour autant savoir quel lien elle entretient réellement avec le réel. L’apparition du « fact-checking », de termes comme « fake news » ou « faits alternatifs » traduit implicitement l’aveu que la confrontation au réel devient de plus en plus difficile. L’IA ne fait que poursuivre cette tendance.

Les modèles de langage comme ChatGPT font partie des développements techniques les plus remarquables de ces dernières années, tant la qualité linguistique et du contenu des textes générés est souvent admirable. Mais puisque ces modèles reposent uniquement sur le « corpus de connaissances » et ne peuvent établir aucun lien direct avec la réalité, ils illustrent de manière frappante comment une structure logique interne d’un texte peut se détacher complètement du lien avec la réalité ou produire des affirmations contrefactuelles, donc contraires à des événements réels, historiques ou autres. Grâce à des méthodes d’entraînement plus précises, les développeurs ont pu, ces dernières années, réduire ces affirmations contrefactuelles, parfois aussi appelées « hallucinations »1. Cependant, je me demande si leur présence doit être considérée moins comme un problème de programmation des modèles de langage que comme une caractéristique d’un gigantesque « corpus de connaissances » qui tend à s’émanciper de plus en plus de la réalité. Ce qui nous apparaît aujourd’hui comme un dysfonctionnement, éventuellement amusant, de l’IA pourrait-il devenir demain la norme dans une société vivant de plus en plus en dehors de la perception corporelle ? L’intelligence artificielle ne reflète-t-elle pas des phénomènes que nous pourrions étudier dès à présent en nous-mêmes ? Sous cet angle, l’inquiétude que les systèmes d’IA deviennent un jour semblables aux êtres humains semble infondée : ce sont les humains qui deviennent de plus en plus semblables à l’IA. La pédagogie Waldorf et le goethéanisme, dans leur approche centrée sur l'expérience régulière et consciente, sensorielle et physique, apparaissent de plus en plus comme des exigences incontournables et essentielles de notre époque.

Apprendre sans l’expérience

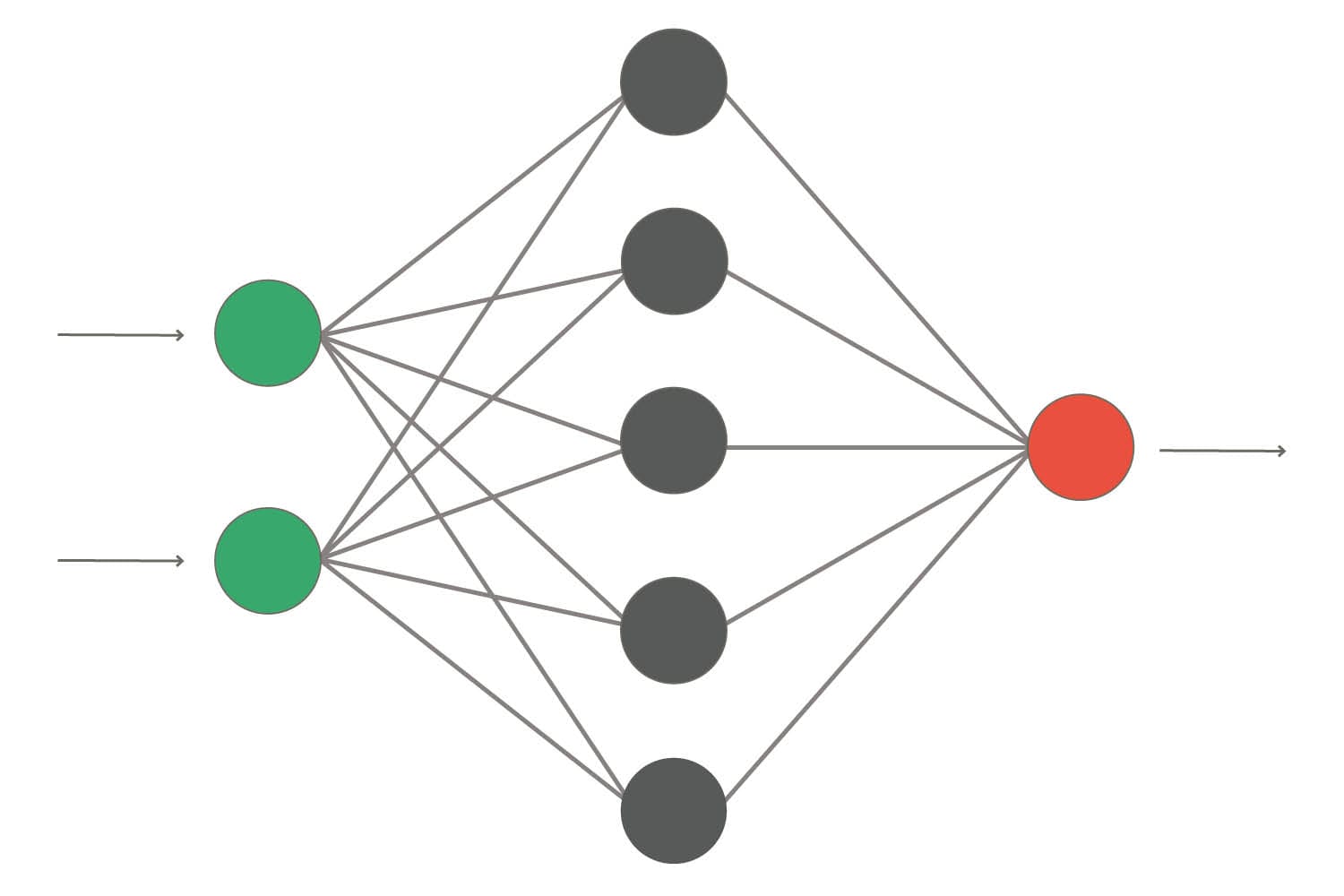

Les gens apprennent par l'expérience, qui permet parfois d'entrer en rapport avec une certaine réalité douloureuse. Une entité désincarnée, agissant uniquement dans l’espace numérique, ne peut faire cela. Alors, que signifie « apprendre » pour l’IA 2 ? Les réseaux neuronaux, qui constituent la base de l’entraînement des modèles de langage, sont des structures dotées d’un nombre très élevé de paramètres. Ces paramètres prévoient une adaptation : plus le nombre de paramètres est grand, plus les possibilités d’adaptation sont étendues. Mais on ne dispose généralement d'aucun critère permettant de déterminer l'importance d'un paramètre donné ou la manière dont il pourrait être défini. Alors comment une adaptation est-elle possible ? Cela peut se faire par des processus d'optimisation (entraînement) dans lesquels, selon le principe « essai-erreur », on vérifie si le modèle, avec un ensemble de paramètres aléatoires, permet une meilleure adaptation à l'ensemble de données sur lequel repose l'entraînement. En fonction du degré d’adaptation, les paramètres sont fixés ou à nouveau modifiés. Il s'agit d'une approche qui suit un principe évolutif de sélection et de tri, tel qu'il a été présenté à plusieurs reprises pour la théorie de l'évolution de Darwin, souvent simplifié, comme ici. L'apprentissage adaptatif dans le réseau neuronal repose sur ce principe évolutif, donc quels espaces de développement de l'IA sont envisageables ?

En tant que physicien, j'apprends volontiers ici de mes collègues issus du domaine de la biologie et des sciences de la vie : la variation et la sélection naturelle permettent de comprendre à merveille comment une espèce s'optimise dans une niche, s'adapte à un habitat ou s'adapte à des conditions environnementales changeantes. Cependant, la formation d’une nouvelle espèce reste difficile à expliquer, car elle exige des centaines de modifications coordonnées dans l’organisme, entraînant d’abord de sérieux désavantages dans l’environnement initial, avant d’offrir des avantages significatifs dans le nouveau milieu. La sélection naturelle explique la survie des formes de vie adaptées, pour laquelle Darwin, s'inspirant de Spencer, utilisait déjà la formule « survival of the fittest » [la survie du plus apte]. Mais l'apparition de ces formes de vie, probablement qualifiée pour la première fois d'« arrival of the fittest » [arrivée du plus apte] par le botaniste néerlandais Jacob Gould Schurman3, reste incomprise selon la théorie de l'adaptation par sélection et sélection naturelle. En effet, le concept de « sélection naturelle » repose sur le principe que les changements évolutifs ne résultent pas de l'apprentissage des êtres vivants en interaction avec leur environnement, qui se perdent sans cesse lors du passage à la génération suivante. Pour le mécanisme évolutif, le rapport à la réalité se fait principalement dans la sélection. Les processus d'apprentissage ne jouent justement aucun rôle. La transmission héréditaire des capacités et des caractéristiques acquises par les processus d'apprentissage de certains spécimens de l'espèce a été catégoriquement exclue4. Considérée comme une entité spirituelle, une espèce « apprend » cependant par la variation et la sélection naturelle de ses spécimens. Les réseaux neuronaux reproduisent cette forme d'apprentissage dans leurs structures et leurs stratégies d'optimisation. La similitude structurelle entre les réseaux neuronaux et la théorie de l'évolution de Darwin suggère que les espaces de développement des modèles d'IA basés sur les réseaux neuronaux se limitent à des optimisations dans des niches. De ce point de vue, on ne voit pas comment quelque chose de nouveau, une nouvelle forme créative, un nouveau style artistique par exemple, pourrait voir le jour. Dans l'autoréférence constante, répétée des milliards de fois par l'IA au sein du « corpus de connaissances », l'avenir ne peut être envisagé que comme une continuation permanente du passé.

L’importance de l’individu pour l’évolution

À l'instar des stratégies d'adaptation des réseaux neuronaux, nous considérons l'évolution sur Terre comme une question de développement des espèces. En tant qu'entité spirituelle, chaque espèce est une sorte de super-organisme capable de transformer son habitat. En tant qu'êtres vivants individuels, nous nous considérons toujours comme insignifiants. Cependant, certains indices suggèrent que, dans l'évolution biologique également, des développements soudains résultent précisément des processus d'apprentissage individuels de certains individus. Ainsi, l'observation de la plasticité, c'est-à-dire de la capacité d'adaptation et d'apprentissage de certains spécimens, et la transmission héréditaire des caractéristiques acquises par ceux-ci ont permis de combler une lacune dans la compréhension de l'apparition des vertébrés terrestres à partir des poissons pulmonés5. Il se pourrait qu'une population initialement peu nombreuse ait réussi à franchir le cap évolutif décisif vers la vie terrestre. On pourrait, bien sûr, citer des exemples très similaires tirés de l'histoire culturelle. De tels phénomènes sont inimaginables dans les systèmes d'IA actuels. Non seulement en raison de l'absence de confrontation des modèles avec le réel et du principe de développement des modèles par adaptation sélective, mais surtout parce que le modèle ne contient que des paramètres individuels à la place d'organismes vivants individuels ou d'exemplaires d'espèces, qui ne peuvent pas ouvrir l'espace de développement ouvert par l'individu dans le développement naturel et culturel.

Adaptation française

Camille Ablard & ÆTHER X

Source

Notes

1 | ChatGPT/

2 | Il a été relevé, à plusieurs reprises, que des termes tels que « apprendre » ou « hallucination », etc. recourent à des anthropomorphismes et sont parfois utilisés par des assistants linguistiques tels qu'Alexa, ce qui masque le caractère purement statistique de ces phénomènes et peut conduire à la personnification des modèles linguistiques. Voir par exemple : Matthias Rang, « Das verliehene Du. Elemente unseres Verhältnisses zur Technik » [Le « toi » prêté. Éléments de notre rapport à la technologie], Magazine Stil, 45e année, cahier 3, 2023, p. 7-15.

3 | Glenn Branch, « Whence "arrival of the fittest"? », National Center for Science Education, 2015.

4 | Cf. par exemple Johannes Wirz, Ruth Richter, « Epigenetik und epigenetische Vererbung » [Épigénétique et hérédité épigénétique], in : Reinhard Wallmann, Ylva-Maria Zimmermann, Biologie in der Waldorfschule. Praxishandbuch für die Oberstufe [La biologie à l'école Waldorf. Manuel pratique pour le secondaire], Stuttgart, 2019.

5 | Emily M. Standen, Trina Y. Du, Hans C. E. Larsson, « Developmental plasticity and the origin of tetrapods » [Plasticité développementale et origines des tetrapodes], Nature 513 (7516), 2014, p. 54-58. Voir aussi Johannes Wirz, Ruth Richter, « Als die Fische gehen lernten » [Quand les poissons ont appris à marcher], Elemente der Naturwissenschaft 103, p. 116-119.

Discussion pour membres